【執行案例】科技藝術計畫《與細菌混了3000年》創作分享會

「太空探索」在今日已不是天方夜譚,而與太空有關的藝術表達形式也隨之而生。《與細菌混了三千年》即是藝術家們對人類中心思想與太空發展領域所提出的別樣想像,為一跨領域的推測性設計劃(speculative design),透過仍在開發中的科技去描述一個可能的未來,試圖以「共生」(symbiosis) 和「親屬關係」(kinship) 的邏輯想像未來居於星際之間的生活樣貌。

「太空探索」在今日已不是天方夜譚,而與太空有關的藝術表達形式也隨之而生。《與細菌混了三千年》即是藝術家們對人類中心思想與太空發展領域所提出的別樣想像,為一跨領域的推測性設計劃(speculative design),透過仍在開發中的科技去描述一個可能的未來,試圖以「共生」(symbiosis) 和「親屬關係」(kinship) 的邏輯想像未來居於星際之間的生活樣貌。

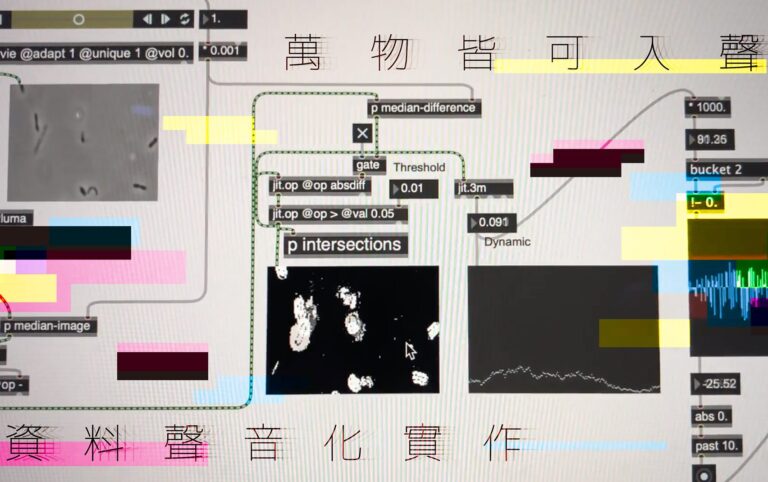

在後人類思潮下,人與其他物種的關係被重新檢視,各種存在實體的能動性可以怎樣透過創意科技去彰顯,讓抽象概念能被轉譯,在視覺、聽覺感官回饋種創造想像空間,即是我們能利用「資料聲音化」來實驗的場域。藝術家紀柏豪將會介紹資料聲音化(data sonification)的概念與案例,並使用Max 8軟體來進行實作。

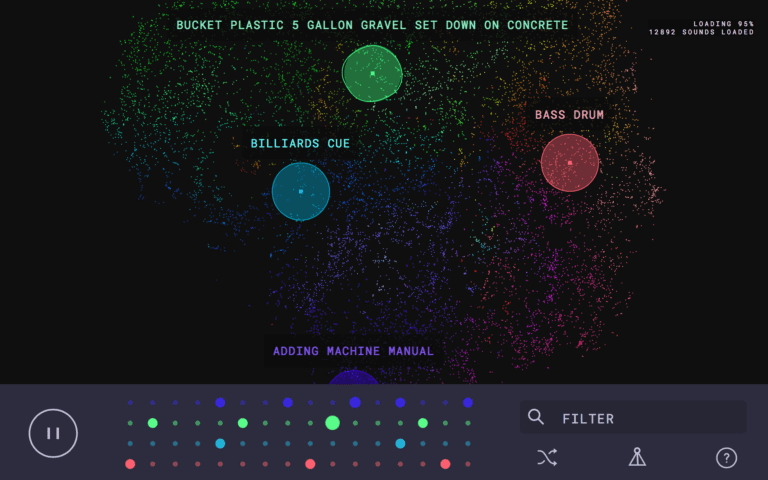

這回將座標定位高雄鳳山,深入民間,以聲音作為媒介,挖掘在地街坊的各種日常聲響,試圖找出那些熟悉的、刻意的,或不經意的聲音風景。我們搜集了鳳山在地街坊各種日常聲響,將其轉化為可自由編排的音樂元素。經由群眾參與作品,通常被視為噪音的街坊環境聲將與樂音交織,成為組構日常節奏的共創過程。

《赫茲遊樂場》為兩廳院「不只在劇場」徵件獲選作品,由涵蓋藝術、音樂、表演、影像、策展、工程等不同背景的成員協力完成。在後疫情時代,我們能如何運用數位科技的優勢,在人與人、人與行動裝置間建立起更緊密的合作關係?該如何讓參與者在使用手機時,能認知到自己與他人的連結,感受到現場性同時找回身體?

作品-雙向傳輸(Duplex Transmission)藉由探討「無所不在的「網路」該如何被應用於展演之中」、「網路如何反應人們的行為與狀態的分佈」、「網路如何將不可視的數據轉化為樂音」、「如何將抽象資訊經過轉譯後顯得更為詩意」等問題,帶領觀眾一步一步進入作品脈絡。

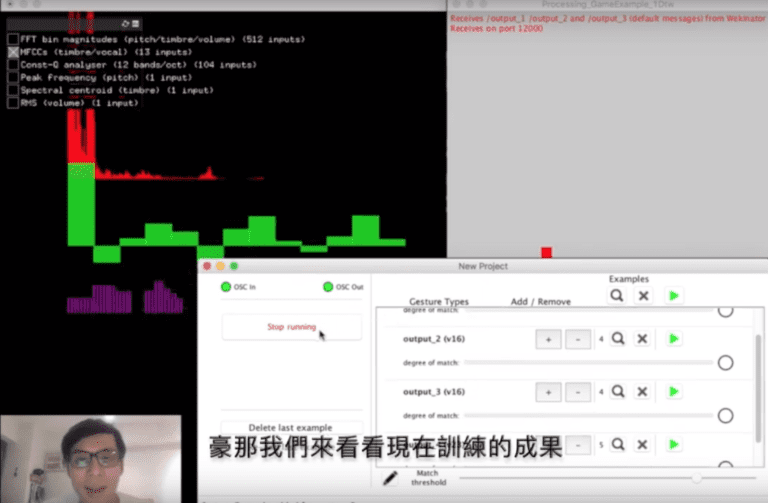

大家可能有在手機上玩過一些小遊戲APP,會讓玩家透過人聲來控制角色的移動。如果想要在個人電腦上達成這樣的應用,又不想要寫太多Code,我們應該怎麼透過數位工具與Creative Coding來實現呢?

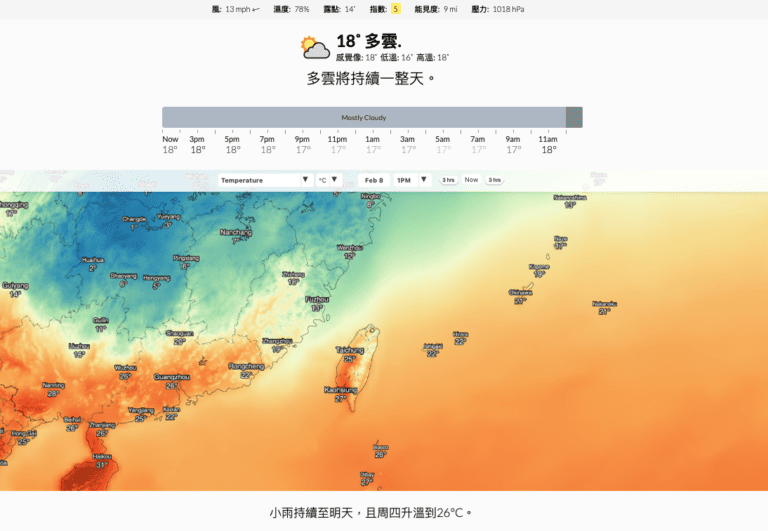

資訊聲音化(Sonification)是能讓人用聽覺來理解周遭不可見事件與狀態的一個詩意手法。這次要跟大家分享一個「把天氣資訊轉換成聲音」,像是在聆聽周遭環境變化一般的Max實作練習。完成的Max Patch程式截圖如下圖,包含了會自動顯示的位置、溫度、風速與天氣類型的Message。

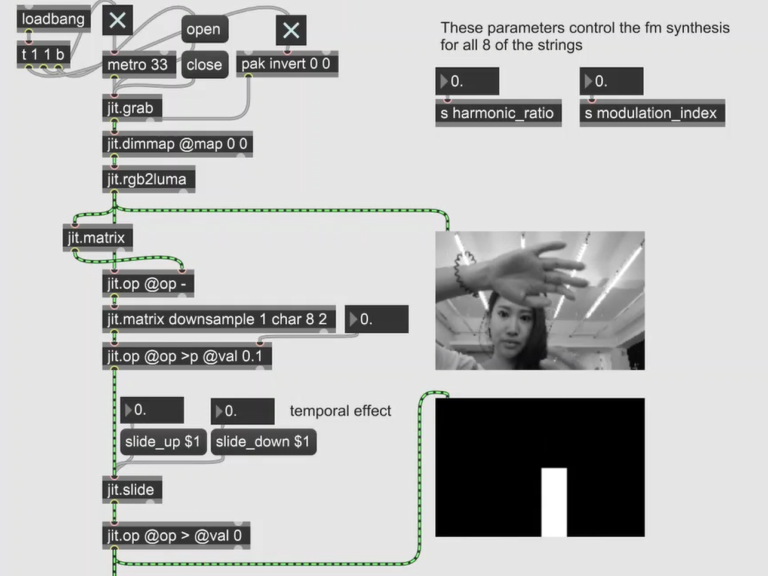

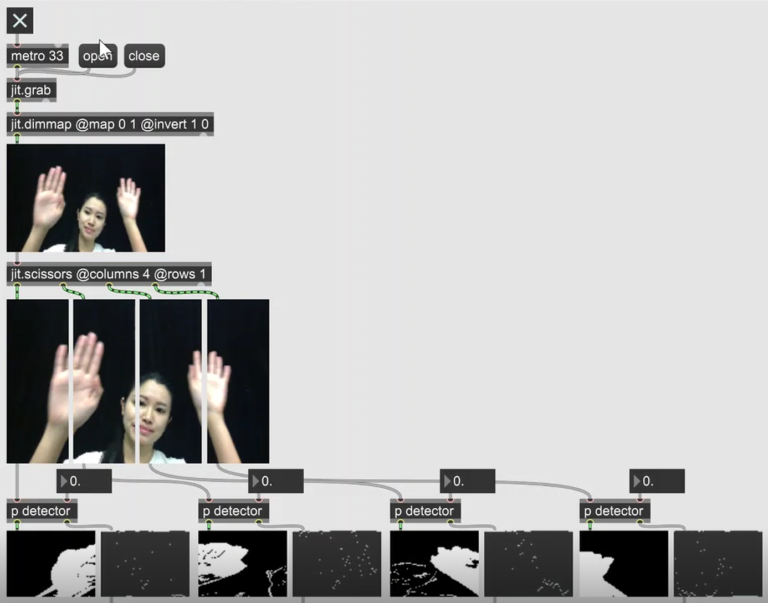

將捕捉到的及時影像做分格處理,藉由偵測到不同區塊的影像變化來觸發音效。其中影像分格的方式也模擬了大家彈奏豎琴時利用兩隻手撥弦的動作,演奏起來真的就像在空氣中撥弄豎琴的樣子。

捕捉即時影像,並將捕捉到的影像分格,藉由偵測到不同區塊的影像變化來觸發聲音的Max Patch。利用簡單的動作變化來觸發預設好的聲音物件,即便只有一個人也可以像擁有整個樂隊一樣喔。

Google於2016年中開展「Magenta」計畫,探索機器學習在音樂與藝術創作過程中所能扮演的角色,以實現更趨近於人類表現性的數位語言。即使背後運算原理相當複雜,但成果都是為了使創作過程能夠變得更直覺且具啟發性,讓每個人都能運用這些工具體驗全新的音樂生成路徑,而非憑藉大數據來取代人的創意。