資料聲音化——日蝕跟維基百科居然能變成一首歌?

在大家了解「生成式音樂」以及「資訊聲音化」後,本篇文章將和大家分享將兩者結合的案例。

結合「資料聲音化(data sonification)」的生成式音樂

將外部資訊串流做為輸入生成系統的內容,這類應用通常依賴於其他系統產生的事件或數據。例如,用即時資訊(real-time data)來呈現某種狀態的變動。 藝術家Tero Parviainen有一個專案《Trams of Helsinki》,利用赫爾辛基的鐵路交通來作曲,即時讀取列車進站資訊來觸發樂音,把大眾運輸系統的動態變成音階上的音符。某種程度上,這也是隨機性的展現,因為這些音樂是附加的,火車駕駛並非有意要傳遞音樂給任何人。但這在概念層面卻很重要,「正在聆聽城市的神經系統」的想法,會改變你體驗音樂的方式。

又例如《Listen to Wikipedia》這個專案,將數百萬網友通力合作更新的維基百科變成生成式音樂系統。其介面設計為浮動圖案,樂音會隨著每筆資料的新增而出現,將生硬的關鍵字幻化為引人好奇的泡泡,讓人透過視覺與聽覺來感受資料洪流的脈動。

2017年八月,美國出現大規模的日蝕現象。位於美國舊金山的科學探索館(Exploratorium)對此進行了數個同步直播,其中最特別的,是與Kronos Quartet合作的現場音樂直播。作曲家韋恩·格林姆(Wayne Grim)透過演算法,於Max/MSP環境中,將太陽黑子爆炸的資訊轉換為圖像,樂手需要解讀這些圖像,依照預先設計好的規則來演奏。格林姆期望呈現某種不可預期性(unpredictibility),因而捨棄傳統的記譜法,將圖像分成23個單元,每個音符在構圖過程中都必須重複一定次數,而作品的旋律及和聲由單元的播放順序決定-其中也包含了音樂家的即興創作。把天體運行的足跡轉換成聽覺經驗,就像是為太陽消失的行為創造了一個全然現場的聲音翻譯,也使整個日全蝕過程,變成一場獨一無二的交響樂。

👉延伸閱讀:生成式音樂案例介紹、什麼是「資訊聲音化」 、萬物皆可入聲(二)Trope app by Brian Eno

相關文章

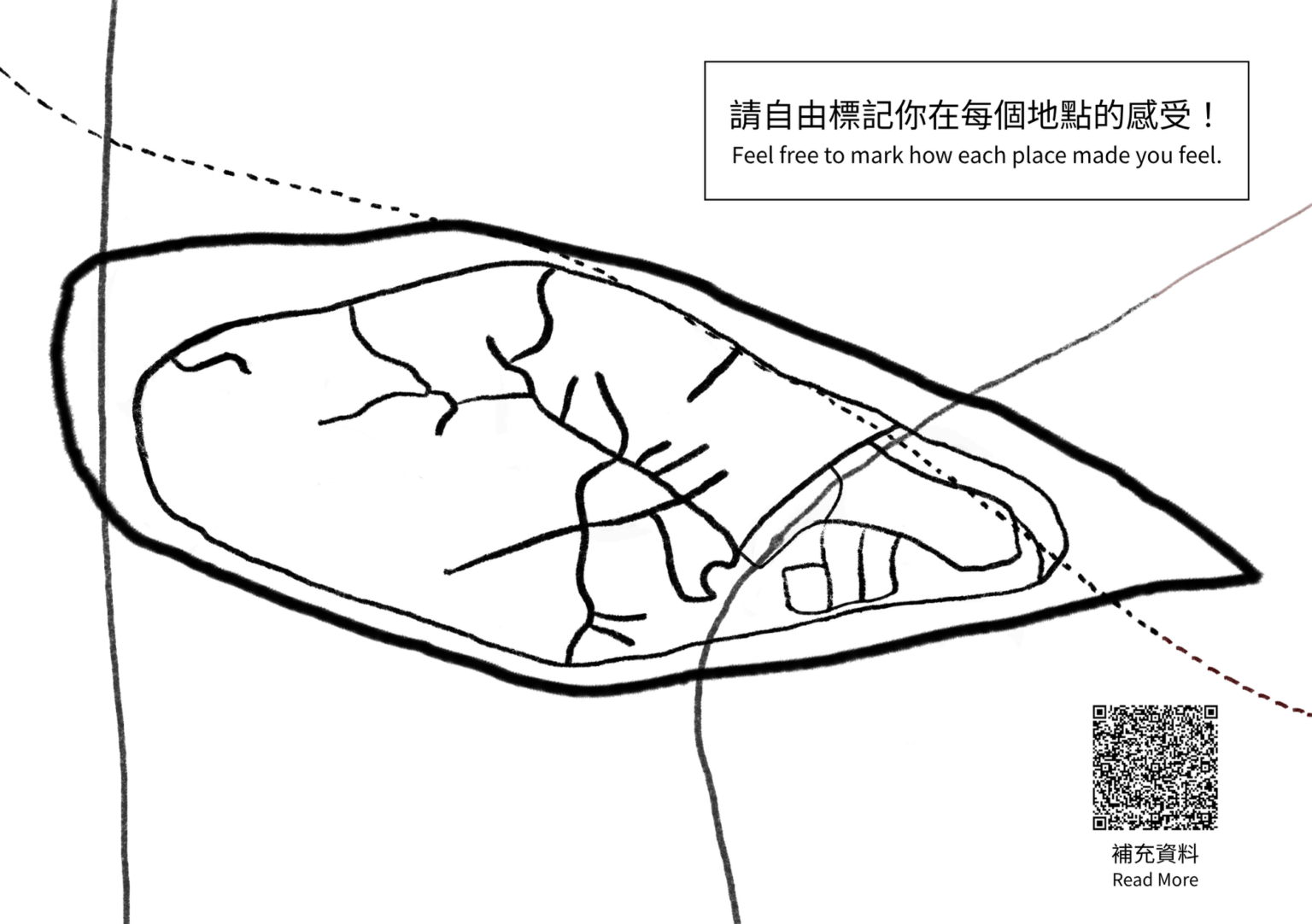

在舊港島練習節奏分析:從 Lefebvre 的 Rhythmanalysis 談起

參考法國思想家 Henri Lefebvre 在《Rhythmanalysis》提出的節奏分析,我們把夜間與日間的走訪、感知卡片、島嶼模型製作等活動,視為一次在現場展開的節奏實驗。這篇文章整理這套方法背後的理論線索,也說明它如何被轉寫成實際可操作的感知工具。